基于脑电图(Electroencephalogram,EEG)的情感识别是近年来人机交互领域的一个热点问题,其核心思想是使机器能够基于非侵入性获得的自发脑电图模式建模来识别人类的情感反应,并通过令人满意的反馈与人类互动.

在情感识别领域中情感的识别与分类尤为重要,目前情绪识别的分类方法有很多.例如,Martinez et al[1]训练了一个有效的深度卷积神经网络,利用皮肤电导和血量脉冲信号对四种认知状态(放松、焦虑、兴奋和乐趣)进行分类.Längkvist et al[2]应用深度置信(信念)网络(Deep Belief Network,DBN)和隐马尔可夫模型对多模式临床睡眠数据集进行睡眠阶段检测.这些研究中,深度学习模型的分类结果与人为规定特征类型的分类方法相当.Duan et al[3]首先将微分熵引入情感识别,比较不同特征的识别特性,并使用支持向量机(Support Vector Machine,SMV)作为分类器,平均准确率达到81.17%.Wang et al[4]系统地比较三种脑电特征(功率谱特征、小波特征和非线性动力学特征)对情绪分类的影响,提出一种用流形学习跟踪情绪变化的方法.基于脑电的识别模型通常取决于每个被试,而生物信号[5-6]有很大的个体变化,所以大多数脑电分类方法是在一个被试相关的场景中开发的,而专注于被试无关的脑电分类模型[7-12]很少.Zhang et al[7]提出基于脑电的意图分类的非线性最小(Nonlinear Least,NAL)反复注意模型(Convolutional Recurrent Attention Model,CRAM),概括不同受试者的脑电模式.Al Machot et al[13]提出基于EEG的情绪的卷积神经网络(Convolutional Neural Networks,CNN)的架构来学习强大的EEG功能并获得了高性能.上述研究中,情绪分类模型多具有被试依赖性,即每个被试都需要训练一个特定的分类器去分类,因此在跨被试应用上有较大阻碍.

另一方面,大多数与被试无关的模型只专注于增加准确性而不是减少个体差异.为解决这个问题,Li et al[13]使用双半球域对抗神经网络(Bi⁃Hemispheres Domain Adversarial Neural Network,BiDANN)最小化源和目标域之间人脑每个半球域差异的模型通过梯度反转层.本文提出深度学习的方法,以减少个体差距脑电信号.

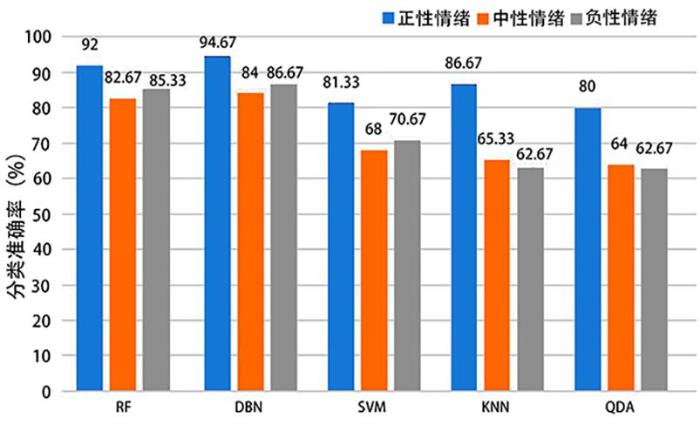

本研究基于SEED数据集探索跨被试情绪识别模型,将所有被试的脑电数据合并为一个被试,使用K最近邻(K⁃Nearest Neighbor,KNN)、二次判别分析法(Quadratic Discriminant Analysis,QDA)、SVM、随机森林(Random Forest,RF)和DBN分类方法对比不同分类器的分类精度,实验结果证明RF的分类效果最好.还分别计算每个分类模型对正性(positive)、中性(neutral)、负性(negative)情绪的分类准确率,发现DBN和RF对负性和中性情绪的识别率较高,能有效进行情绪识别.

1 实验和被试

1.1 数据集简介

表1 情绪实验中采用的电影片段细节

Table 1

| 序号 | 情绪标签 | 电影片段来源 |

|---|---|---|

| 1 | 消极 | 《唐山大地震》 |

| 2 | 消极 | 《1942》 |

| 3 | 积极 | 《泰囧》 |

| 4 | 积极 | 《唐伯虎点秋香》 |

| 5 | 积极 | 《越光宝盒》 |

| 6 | 中性 | 《世界遗产在中国》 |

html上获得

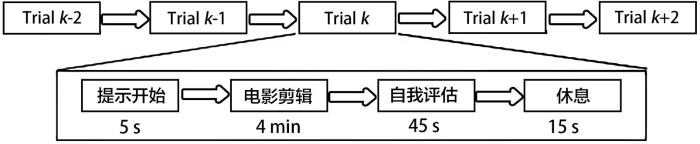

每次实验都需要把15个电影剪辑都看完,因此每次实验都有15个试验trial.开始播放电影片段之前有5 s提示,接着播放电影片段,时长约4 min.为了及时反馈,要求被试在观看每个短片后立即填写问卷,报告他们对每个短片的情绪反应.自我评估的时间为45 s,评估后休息15 s.相同情感的两个电影片段不会连续地显示,实验范式如图1所示.

图1

图1

电影呈现时序(上)及单个trial时序(下)示意图

Fig.1

Schematic diagram of film presentation time sequences (up) and a single trial sequence (down)

1.2 被试

在SEED数据集中招募15名被试(男7名,女8名,年龄19~28岁,平均23.27岁,方差2.37岁)参与实验.每个参与者进行三次实验,两次实验间隔一周或更长.所有参与者均为上海交通大学的学生,自述视力正常或已矫正至正常,听力正常.实验时被试应舒适地坐着,避免身体及肢体运动,专心观看电影片段;周围环境保持安静,避免影响被试对电影的注意力;同时记录被试的面部视频和脑电数据.采用ESI⁃Neuro⁃Scan系统记录EEG信号,采样率为1000 Hz,电极帽为有源AgCl电极,按照国际10⁃20系统排布62个通道.

1.3 数据预处理

采用MATLAB分析(.mat文件),将原始EEG数据下采样至200 Hz,并采用0~75 Hz的带通滤波器进行滤波,提取对应每部电影持续时间的脑电片段.每名受试者进行三次实验,每次实验有15个trial,每个trial有一个.mat文件,共45个.mat文件.每个.mat文件包含16个数组,包括一个实验中15个trial的分段预处理脑电数据(EEG⁃1~EEG⁃15,通道×数据)及一个标签数组,包含相应的情感标签(正标签为+1,中性标签为0,负标签为-1).

2 方 法

情感计算是一个跨学科的领域,人类情感的监测和建模是模式识别和机器学习技术在情感计算中的应用.尽管近年来情感计算得到了迅速的发展,但仍有许多亟待解决的问题[1].在基于不同生理信号的情绪识别方法中,基于EEG信号的情绪识别方法具有较高的准确性和客观的评价能力,各种心理生理学研究已经证明了人类情绪和脑电信号之间的相关性[15].此外,随着可穿戴设备和干电极技术的快速发展[16],现在可以实现基于脑电的从实验室到日常环境的情感识别应用,例如驾驶疲劳检测和精神状态监测[17].然而,脑电信号的信噪比很低,采集时往往混有大量噪声;与图像或语音信号不同,脑电信号还具有时间不对称性和非平稳性.传统的脑电特征提取和特征选择是情感建模的关键,需要特定的领域知识.因此,本文提取传统的时域特征、频域特征、时⁃频域特征及电极组合特征,使用ReliefF算法[18]进行特征选择,选出使用频率最高的特征并利用此特征训练不同的分类器以提高情绪识别的准确率.

2.1 频域特征提取

2.1.1 PSD特征

频域特征主要是功率谱密度(Power Spectral Density,PSD)特征.PSD描述信号的功率随频率的变化情况,其计算方式有很多,可分为直接法和间接法.直接法包括周期图法、Welch法等线性经典谱估计法,本文采用Welch法计算PSD[19].得到功率谱后,根据给定的某一波段计算该波段内功率谱密度的均值、最值、方差等统计量作为特征.

2.1.2 微分熵特征

微分熵(Differential Entropy,DE)是香农(Shannon)熵在连续变量上的推广,即:

其中,

2.2 时⁃频特征

2.2.1 短时傅里叶变换(Short⁃Time Fourier Transform,STFT)特征

STFT对低信噪比的信号有更好的抗干扰能力[21],使用等长的窗函数

通常,窗函数默认使用Gauss函数,STFT也称Gabor变换.此外,时间窗长度的选择至关重要:时间窗过短,提供的信息量不足,会导致频域分辨率变差;而时间窗太长,又会导致各窗时域分辨率差.目前情绪识别研究中使用的时间窗长度多为1∼2 s[22],本文采用的时间窗为1 s.考虑EEG信号的采用率为200 Hz,所以MATLAB程序中STFT的窗函数设为200点.

2.2.2 小波特征

小波变换和STFT相比的一个优势是能同时提高时域和频域的分辨率.小波变换主要有两种基本类型:连续小波变换(Continuous Wavelet Transform,CWT)和离散小波变换(Discrete Wavelet Transformation,DWT)[23],其主要区别在于小波基的参数是否可以连续取值,参数只能离散取值时为DWT.使用DWT特征,小波基选取EEG研究中最常用的DB_4.任意

2.3 空域特征

按照国际10⁃20系统排布的电极具有对称性,而不同情绪状态下左右半球产生的EEG信号不对称:消极情绪能激活右侧额叶、颞叶和顶叶;而积极情绪可以激活左侧区域[24].因此,利用电极组合特征可以获得EEG的空域特征,可称为不对称差(Diff⁃rential Asymmetry,DASM)或不对称商(Rational Asymmetry,RASM).DASM和RASM分别指左右对称电极上特征的差值和比值.

表2 SEED数据集的27对对称通道与23对不对称通道

Table 2

| 公式 | 通道 |

|---|---|

Fp1⁃Fp2,F7⁃F8,F3⁃F4,FT7⁃FT8,FC3⁃FC4,T7⁃T8,P7⁃P8,C3⁃C4,TP7⁃TP8,CP3⁃CP4,P3⁃P4,O1⁃O2,AF3⁃AF4,F5⁃F6,F7⁃F8,FC5⁃FC6,FC1⁃FC2,C5⁃C6, C1⁃C2,CP5⁃CP6,CP1⁃CP2,P5⁃P6,P1⁃P2,PO7⁃PO8,PO5⁃PO6,PO3⁃PO4,CB1⁃CB2 | |

| FT7⁃TP7,FC5⁃CP5,FC3⁃CP3,FC1⁃CP1,FCZCPZ,FC2⁃CP2,FC4⁃CP4,FC6⁃CP6,FT8⁃TP8,F7⁃P7,F5⁃P5,F3⁃P3,F1⁃P1,FZ⁃PZ,F2⁃P2,F4⁃P4,F6⁃P6,F8⁃P8,FP1⁃O1,FP2⁃O2,FPZ⁃OZ,AF3⁃CB1,AF4⁃CB2 |

2.4 特征组合

feature1为STFT特征,将信号分为delta (1~4 Hz),theta (4~8 cHz),Low_alpha (8~10 Hz),alpha (8~12 Hz),beta (12~30 Hz),gamma (30~45 Hz),计算每个频段的PSD特征及PSD的均值、最值、方差、差分等统计量,其特征矩阵为675×9238的二维矩阵.记feature2为DWT特征,使用DB_4小波基对EEG信号进行五级分解,并计算小波系数的信息熵特征、统计特征,其特征矩阵为675×1116的二维矩阵.记feature3为不对称特征,首先使用feature1的特征计算每一频段的功率谱,然后计算DASM特征及DCAU特征,结果为675×(27+23)×6的二维矩阵.为了使用本文提出的特征选择方法,将所有特征串联起来,即在MATLAB中表示为

2.5 特征选择

表3 Relief的伪代码程序

Table 3

设训练数据集为D,样本抽样次数m,特征权重的阈值δ,输出各个特征的权重T. 1.置0所有特征权重,T为空集. 2.ƒor i=1 to m do (1)随机选择一个样本R; (2)从同类样本集中找到R的最近邻H,从不同类样本集中找到最近邻样本M; (3)ƒor A=1 to N do 3.ƒor i=1 to N do if 把第A个特征添加到T中 end |

虽然Relief算法运行效率高,但只能处理两个类别的数据,而本文涉及三类数据,因此更适合采用ReliefF算法.该算法是Relief算法的多分类推广,其伪代码如表4所示

表4 ReliefF的伪代码程序

Table 4

设训练数据集为D,样本抽样次数m,特征权重的阈值δ,最近邻样本个数k;输出为各个特征的特征权重T. 1.置所有特征权重为0,T为空集. 2.ƒor i=1 to m do (1)从D中随机选择一个样本R; (2)从R的同类样本集中找到R的k个最近邻 3.ƒor A=1 to N All feature do end |

3 实验结果

对比研究不同的分类方法,先计算STFT特征及DWT特征,特征矩阵为一个675×10354的二维矩阵;接着使用ReliefF进行权重排序,ReliefF的最近邻数设置为5.将特征向量矩阵分为训练集和测试集,并使用浅层的机器学习算法进行分类,如KNN,QDA,SVM,RF等;再与深度学习模型进行对比,深度学习算法采用DBN.本节系统评估五个分类器的分类性能,以提高情绪识别的准确率.

系统地比较KNN,QDA,SVM,DBN,RF五种分类器在基于EEG的情绪识别中的分类性能,这些分类器使用上述经过ReliefF选择的STFT特征作为输入,训练数据在特征向量矩阵中随机选择600行,测试数据为剩下的75行.各个算法的参数设置如表5所示.

表5 不同算法的参数设置及输入数据维度

Table 5

| 算法 | 参数设置 |

|---|---|

| KNN | 输入特征维度从 |

| QDA | 输入特征维度612,1224,2448 |

| SVM | 输入特征维度612,1224,2448 |

| DBN | 隐藏层层数为1,隐单元数 |

| RF | 随机抽取数: 原始数据分三组,特征维度612,1224,2448 |

KNN,QDA使用MATLAB自带的fitcknn,fitcdiscr函数完成.KNN,QDA的训练数据的特征维度都分为三组,分别是612,1224,2448.KNN的最近邻数为50,100,150,200,250,300,通过遍历每个参数以获得最优分类准确率.同理,SVM的训练数据的特征维度也分为三组,分别是612,1224,2448.算法基于LibSVM工具箱实现,核函数选择RBF核,并使用SVMcgForClass优化损失参数

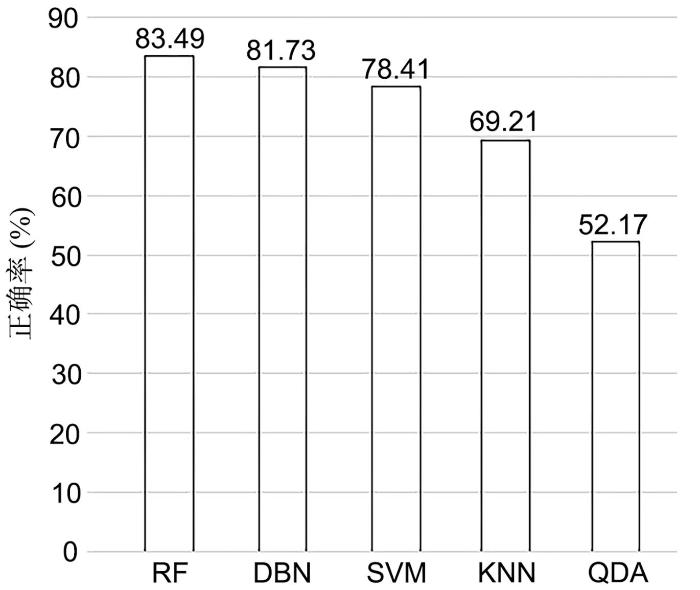

本研究比较了五个分类器的平均分类准确率,结果如图2所示.

图2

图2

不同分类器的平均分类性能对比

Fig.2

Average classification performance of different classifiers

由图可见,RF的分类效果最好,且当输入的特征维度为1224,trees数为200时可获得最佳分类效果,7折交叉验证下分类准确率为83.49%±2.6%.DBN在结构为800×400×3时分类结果最好,7折交叉验证下分类准确率为81.73%±2.22%.SVM在训练集特征维度为612时效果最佳,最优分类准确率为78.41±3.8%.KNN,QDA都在训练集特征维度为612时效果最好,KNN在最近邻数为50时可获得最高的分类准确率,为69.21±3.4%,QDA的分类准确率为52.17±9.41%.以上结果表明,RF分类器在本框架中的分类表现最好,最高分类准确率达86.67%,对情绪识别有较好的效果;其次,DBN也有较好的分类效果,能有效地进行情绪识别.

使用五个频段的PSD,DE,RASM,DASM,DCAU作为特征,SVM为分类器,基于LibSVM工具箱实现,核函数选择RBF核并使用SVMcgForClass优化损失参数

表6 使用SVM分类器在不同频段识别不同特征的平均准确率(单位:%)对比

Table 6

| Dela | Theta | Alpha | Beta | Gamma | ||

|---|---|---|---|---|---|---|

| 本文 | PSD | 63.75 | 51.25 | 54.375 | 54.375 | 56.875 |

| DE | 47.84 | 48.52 | 57.62 | 64.89 | 66.2 | |

| DASM | 42.24 | 40.65 | 45.72 | 46.35 | 47.41 | |

| RASM | 40.73 | 41.98 | 45.54 | 45.86 | 47.86 | |

| DCAU | 38.56 | 41.44 | 43.56 | 45.51 | 45.65 | |

Singh et al[12] (12通道) | PSD | 57.55 | 62.73 | 65.87 | 75.8 | 75.68 |

| DE | 54.7 | 62.13 | 68.18 | 77.6 | 77.86 | |

| DASM | 46.94 | 46.85 | 59.45 | 69.04 | 70.61 | |

| RASM | 45.88 | 45.97 | 58.97 | 68.8 | 70.58 | |

| DCAU | 37.56 | 41.14 | 43.56 | 45.41 | 45.65 |

由表可知,采用某一特征单独作为训练分类器的特征矩阵获得的分类结果较差,且比Zhang et al[7]的结果低.可能的原因:本文采取的分类策略不同,Zhang et al[7]的研究基于个体,训练的模型具有被试依赖性;而本文采用trial级分类,训练的模型更具实用化,独立于被试.此外,本研究加入了特征选择算法ReliefF,其细节将在下一节介绍.特征矩阵经过ReliefF进行权重排序后使用SVM进行分类,训练集为600×612(前612维特征),测试数据为75×612,经9折交叉验证后平均分类准确率为82.31%±2.89%,表明特征选择方法可以有效提高分类效果,且分类结果与Zhang et al[7]相当.

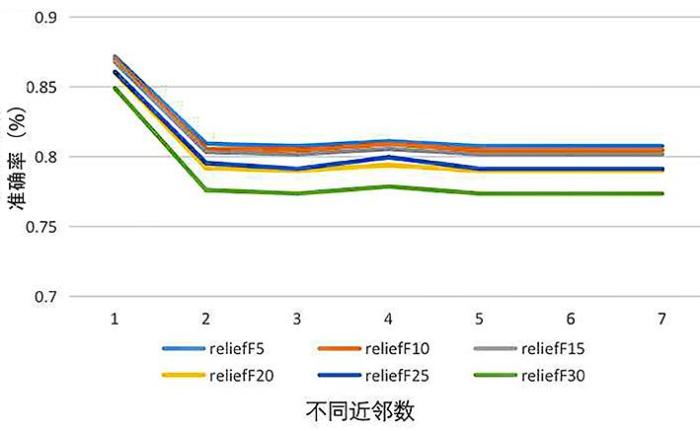

图3

图3

ReliefF使用不同最近邻数对分类结果的影响

Fig.3

Classification results of ReliefF using different nearest neighbor numbers

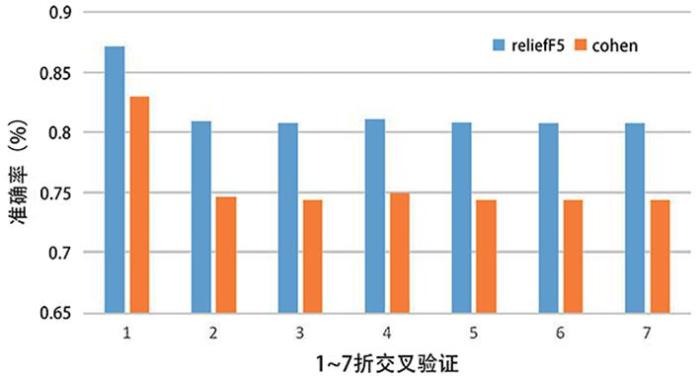

图4

图4

不同特征选择方法对分类结果的影响

Fig.4

Classification results of different feature selection methods

以上结果表明,ReliefF特征选择算法优于cohen's f^2效应量算法.

本文还分别计算了每个分类模型对正性、中性、负性三类情绪的分类准确率(图5).由图可知,不同分类器对正性情绪的识别效果都比较好,而KNN,QDA,SVM对中性和负性情绪的分类效果较差,难以得到高的准确率;而DBN和RF能克服这一问题,对中性和负性情绪的识别率较高.这一结果说明基于DBN的深度学习方法能进一步完成特征选择任务,过滤更新特征,提高分类精度.

图5

图5

不同分类器对三类情绪的分类结果对比

Fig.5

Classification results of three kinds of emotions by different classifiers

4 讨 论

为了进一步研究ReliefF的最近邻数要选择多少才合适的问题,本文使用基于DBN的方法,选取ReliefF5,ReliefF10,ReliefF15,ReliefF20,ReliefF25,ReliefF30等六类近邻数权重排序的前800列用以训练DBN.其中,输入层单元数为800,隐藏层层数为1,隐藏层单元数按50的步长,遍历50~800次,共16组结果,输出层为3.实验结果显示,当DBN结构为800×400×3时,分类结果最好.采用7折交叉验证的方法,系列1到7表示7折交叉验证.首先对特征向量矩阵进行ReliefF权重排序,统计权重较高的特征的使用频次,选出STFT特征作为最优特征;其次,对比研究了ReliefF算法不同近邻数对分类结果的影响.实验结果表明,当最近邻数设置为5时,ReliefF特征选择达到最优.

本文还分别计算了每个分类模型对正性、中性、负性三类情绪的分类准确率,对应的分类精度见图5.由图可知,不同分类器对正性情绪的识别效果都比较好,而KNN,QDA,SVM对中性和负性情绪的分类效果较差,难以得到高的准确率;而DBN和RF对中性和负性情绪的识别率较高.这一结果说明基于DBN的深度学习方法能进一步完成特征选择任务,过滤更新特征,提高分类精度.在进行无监督和有监督学习时,DBN能将特征提取和特征选择结合起来,进一步学习合理的权重分布.同时,在情感建模过程中,特征提取和特征选择是关键,RF的投票表决机制能有效克服数据不平衡带来的影响.

各种方法的实验结果如表7所示,表中黑体字表示最优的实验结果,可以看到RF在各种方法中性能最优.

表7 本研究与其他研究的对比

Table 7

5 结 论

本文首先介绍情绪识别的相关背景和SEED数据集的采集方式和类型,然后对比研究不同特征在跨被试模型的分类效果.这些特征包括PSD,DE,DASM,RASM及DCAU等,可以得出结论:单独提取某类特征用于情绪识别具有被试依赖性,在跨被试模型上不适用.基于此,本文提出一种基于ReliefF特征选择的情绪识别模型,提取EEG信号在频域、时⁃频域、空域对应的STFT特征、小波特征、电极组合特征,并对这些特征进行权重排序,选择高权重特征中频次最高的特征以提高分类准确率.本文还系统对比了ReliefF算法的不同参数设置对情绪识别准确率的影响.最后,基于上述结果,对比不同分类器的分类性能,结果表明:DBN和RF都能获得较好的平均分类准确率,RF的分类效果最好,分类准确率为83.49%±2.6%;DBN分类准确率为81.73%±2.22%,且与其他分类器相比更稳定,对三类情绪的识别效果都较好.本研究可望为跨被试的情绪识别模型提供参考.

参考文献

Learning deep physiological models of affect

Sleep stage classification using unsupervised feature learning

Differential entropy feature for EEG⁃based emotion classification

∥

Emotional state classification from EEG data using machine learning approach

Towards adaptive classification using riemannian geometry approaches in brain⁃computer interfaces

∥

Recurrent convolutional neural network model based on temporal and spatial feature for motor imagery classification

∥

A convolutional recurrent attention model for subject⁃independent EEG signal analysis

EEGNet:a compact convolutional neural network for EEG⁃based brain⁃computer interfaces

Cascade and parallel convolutional recurrent neural networks on EEG⁃based intention recognition for brain computer interface

∥

A deep⁃learning model for subject⁃independent human emotion recognition using electrodermal activity sensors

Subject⁃independent emotion recognition during music listening based on EEG using deep convolutional neural networks

∥

Motor imagery classification based on subject to subject transfer in riemannian manifold

∥

A bi⁃hemisphere domain adversarial neural network model for EEG emotion recognition

Investigating critical frequency bands and channels for EEG⁃based emotion recognition with deep neural networks

Investigating models of affect:Relationships among EEG alpha asymmetry,depression,and anxiety

Novel active comb⁃shaped dry electrode for EEG measurement in hairy site

In⁃flight automatic detection of vigilance states using a single EEG channel

ReliefF for multi⁃label feature selection

∥

Wavelet⁃Welch methodology for analysis of EEG signals of schizophrenia patients

∥

Differential entropy feature for EEG⁃based vigilance estimation

∥

Comparison of STFT and wavelet transform methods in determining epileptic seizure activity in EEG signals for real⁃time application

EEG⁃based emotion estimation using Bayesian weighted⁃log⁃posterior function and perceptron convergence algorithm

Comparison of wavelet transform and FFT methods in the analysis of EEG signals

Asymmetrical brain activity discriminates between positive and negative affective stimuli in human infants

A practical approach to feature selection

∥

心理学常用效应量的选用与分析

research

We are not all equal:Personalizing models for facial expression analysis with transductive parameter transfer

∥

Domain invariant transfer kernel learning

Domain⁃adversarial training of neural networks

Selective transfer machine for personalized facial expression analysis

Eeg emotion recognition using dynamical graph convolutional neural networks

A novel neural network model based on cerebral hemispheric asymmetry for EEG emotion recognition

∥

Subject⁃independent EEG⁃based emotion recognition using adversarial learning

∥