渗流参数在地下水及石油工程领域扮演重要的角色,是描述和预测地下流体运动和能量传递的关键变量.在地下水管理、环境修复和油气田开发等领域,渗流参数如渗透系数的准确反演对于理解和预测地下水流及污染物运移至关重要.这些参数直接影响地下水模型的构建和精确性,进而对水资源评估、污染防治策略的制定与执行具有深远的影响[1].因此,发展高效、准确的渗流参数反演技术是当前水文地质学研究的重要任务之一.

传统的渗流参数预测方法多基于地质调查、泵测试验及自然界中的水文地质现象,这些方法常常因为试验设计复杂、成本高昂、耗时长和在特殊地质条件下的适应性不足而受到诸多限制.此外,参数空间的非线性和模型的不确定性也给传统方法的应用带来了挑战[2].

近年来,随着深度学习技术的飞速发展,越来越多的研究集中于利用神经网络方法进行水文地质参数的反演.例如,Huang et al[3]成功将基于编码器⁃解码器的卷积神经网络(Convolutional Neural Network,CNN)用于多孔介质中非均质多尺度的渗透率反演,同时降低了计算成本.Feng[4]将物理方程融入到生成对抗神经网络(Generative Adversarial Network,GAN)训练中,并成功用于反演储层孔隙度.此外,循环神经网络(Recurrent Neural Network,RNN)因其在序列数据处理中的优势,已被用于时间序列水文数据的分析,辅助渗流参数的动态反演[5].

物理信息神经网络(Physics⁃Informed Neural Networks,PINNs)是一种结合了深度学习和物理定律的新型网络结构,它通过直接在神经网络损失函数中嵌入物理定律,能够让网络预测结果自然满足相应的物理规则.该方法由Raissi et al[6]在2019年正式提出,开启了数据驱动和物理驱动模型融合的新篇章.PINNs的核心思想在于将传统神经网络的优化目标,即减少预测与实际数据之间的差距,扩展到同时满足物理模型.在PINNs中,网络不仅要学习数据特征,还要学习数据背后的物理法则.具体到渗流问题,这意味着网络预测的渗流参数需要同时满足观测数据和达西定律或其他相关流体力学方程,这样的网络结构允许PINNs在数据稀缺的情况下也能做出物理上可靠的预测[7].

在地下水领域,PINNs的应用主要集中于参数估计和流场模拟等多方面.Almajid et al[8]利用PINNs预测了多孔介质流体流动,表明PINNs在融合物理信息和观测数据进行准确预测的有效性,此外还将其用于反演多相流参数并证明其优于没有物理信息的人工神经网络(Artificial Neural Network,ANN).此外,Zhang et al[9]提出了一种求解有井地下水流方程的无标注数据深度学习方法GW⁃PINN,通过多个算例成功展示了其在预测地下水系统中水头的剧烈变化的能力.与传统的神经网络相比,PINNs在渗流参数反演中表现出多方面的优势.首先,它通过内嵌物理定律,减少对大量训练数据的依赖,这在数据获取成本高昂或数据不易获得的地下水研究中尤为重要[10].其次,PINNs能够提供更加物理合理的解释,因为其预测结果必须符合物理定律,这降低了获得非物理解的风险[11].最后,PINNs在处理多物理场问题时表现出色,这使得它可以在处理复杂的地质和地下水系统时,有效整合和模拟多种物理过程[12].

总体而言,PINNs在地下水领域的应用还处于初步探索阶段,但已经显示了强大的潜力.目前PINNs在潜水流问题中的研究极少,特别是对于潜水含水层的渗流参数反演问题的应用,潜水流方程的非线性也进一步加大了参数反演的难度.此外,在PINNs的应用中对边界条件的处理多数采用的是软约束形式,而对硬约束形式的探究较少[13].事实上,软硬约束各有其特别的优势,软约束可以理解为对模型的某些属性或参数采取柔和的限制,而不是硬性地限定它们,使它能保证模型具有足够的复杂性来拟合数据,同时避免过度拟合.硬约束的应用通常包括结构约束和参数范围约束.结构约束是指在某些情况下,使模型的某些部分具有特定的结构或模式,例如稀疏性或对称性.参数范围约束是指确保参数保持在预定义的范围内.硬约束为模型施加了严格的边界条件,使模型在这些条件下始终保持有效.例如,Sun et al[14]引入辅助函数使PINNs自动满足边界条件并进一步证实了PINNs在硬约束下的适用性和准确性.然而,过多或过于严格的硬约束可能会限制模型的能力,使其无法学习复杂的模式.因此,选择适当的约束并平衡其强度是至关重要的.

综上,本文首次将PINNs方法结合软硬约束设置来解决潜水含水层渗透系数反演问题,以一维稳态非均质潜水流以及非稳态均质潜水流(含溶质运移)的渗透系数反演为例,对比了不同问题中PINNs软约束方法(PINNs⁃S)和硬约束方法(PINNs⁃H)反演渗透系数的表现,为后续研究PINNs应用到更复杂的潜水含水层渗流参数反演问题中提供了参考.

1 算法和原理

1.1 控制方程及边界条件

1.1.1 潜水流控制方程

对于计算域为

其中,

设边界条件为Dirichlet边界条件,可以表示为:

根据达西定律,可得到渗流速度

1.1.2 对流⁃弥散方程

本文算例中溶质运移满足潜水含水层中对流⁃弥散方程:

其中,

相关的初始条件可以表示为:

相关的边界条件可以表示为:

其中,

1.2 PINNs

1.2.1 PINNs简介

PINNs是一种前沿的深度学习框架,它巧妙地融合了传统的数值模拟技术与现代的神经网络技术,同时它本质上是一种无网格技术,可以轻松处理不规则域问题[15].通过在损失函数中加入物理约束,PINNs能在数据驱动的学习过程中,同时考虑底层的物理规律.通常,深度学习模型主要依赖于大量的数据进行训练,但在许多实际应用中,数据可能是稀缺的.此时,通过利用已知的物理原理,PINNs可为模型提供额外的指导.具体地,假设下面的微分方程描述了某个物理过程:

其中,

其中,

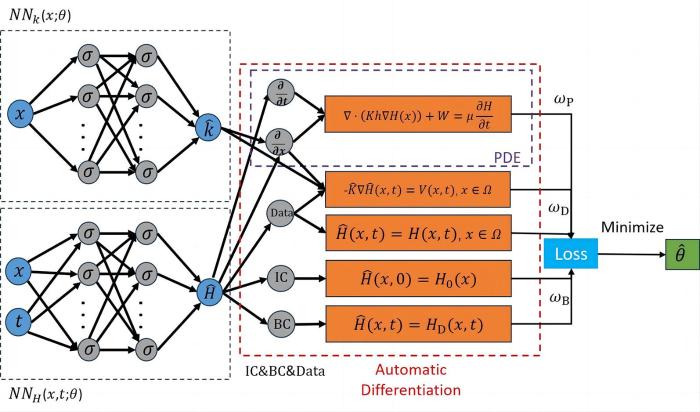

PINNs的网络结构如图1所示,以

图1

1.2.2 自动微分

AD就是自动地应用这一法则,将原函数分解为更简单的函数,并计算每一部分的导数.当优化一个神经网络时,最小损失函数需要计算网络参数的梯度.通过AD可以有效地计算这些梯度,从而使用梯度下降方法来更新网络参数.

1.2.3 激活函数

1.2.4 损失函数及模型评价指标

深度学习中,损失函数(也称目标函数、代价函数或误差函数)是用于衡量模型预测值与真实数据之间的差异的关键组成部分,为优化算法提供了一个明确的指导,使模型能通过迭代不断改进其预测性能.本文训练神经网络模型采用的损失函数为均方误差函数.均方误差(Mean Squared Error,MSE)[26]是最常用的回归损失函数,它表示预测值与真实值之间的平方差的平均值.其数学表达式为:

本文采用的模型预测精度评价指标如下.

最大绝对误差(Maximum Absolute Error,MAE):

平均绝对误差(Average Absolute Error,AAE):

最大相对误差(Maximum Relative Error,MRE):

平均相对误差(Average Relative Error,ARE):

式(

本文的算例用于反演渗透系数场的神经网络的总损失函数包括基于一维潜水流方程的误差(

总的损失函数:

其中,

式(

1.3 硬约束和软约束

1.3.1 软约束

深度学习模型由于其参数数量巨大和非线性特性,通常能够很好地拟合训练数据,但这也可能导致过拟合,使模型在新的数据上表现不佳.而软约束提供了一种平衡模型复杂性和训练数据拟合的方法,它对模型的某些属性采取弹性的限制,可以确保模型具有足够的复杂性来拟合数据,同时避免过度拟合.此外,由于约束是柔和的,模型还具有一定的灵活性,可以更好地适应新的数据.总之,软约束在深度学习中扮演着至关重要的角色,帮助研究人员在模型的表达能力和泛化能力之间找到合适的平衡.

1.3.2 硬约束

在深度学习中,约束条件被广泛应用以确保模型的行为满足某些先验知识或特定条件.这些约束条件可以分为两类:软约束和硬约束.硬约束[27]是那些必须被严格遵守的条件.与软约束相比,硬约束为模型施加了严格的边界条件,使模型在这些条件下始终保持有效.硬约束可以形式化为:

其中,

硬约束的应用通常包括结构约束和参数范围约束.结构约束是指在某些情况下,使模型的某些部分具有特定的结构或模式,例如稀疏性或对称性.参数范围约束是指确保参数保持在预定义的范围内.例如,对于某些模型,可能希望权重矩阵的特征值保持在一个特定范围内以确保数值稳定性.其表达式为:

其中,

然而,值得注意的是,过多或过于严格的硬约束可能会限制模型的能力,使其无法学习复杂的模式.因此,在实践中,选择适当的约束并平衡其强度是至关重要的.总之,硬约束在深度学习中为模型提供了明确的操作边界,确保其行为始终满足预期.和软约束相比,硬约束提供了确定性和鲁棒性的优势,但需要谨慎使用以确保不限制模型的学习能力.

本文主要采用结构硬约束来使PINNs自动满足边界条件,无需在总损失函数中添加额外的边界损失项,从而使网络更快地找到优化方向.基于此,假设研究区为

其中,

2 数值算例

2.1 算例简介

本节将PINNs软约束算法和硬约束算法应用于一维潜水流模型的渗透系数反演,通过参考解与PINNs的预测解的对比,验证两种方法反演渗透系数的准确性并对比它们的预测效果,其中训练PINNs所需的水头数据、溶质运移数据和Darcy流速数据由COMSOL Multiphysics数值模拟软件正向求解水流模型得到.算例中所有的PINNs算法均采用Python语言编写,计算采用深度学习框架Pytorch 1.1.

2.2 一维稳态非均质潜水流渗透系数的反演

地下水一维稳态非均质潜水流模型满足

表1 一维稳态非均质潜水流PINNs算例所采用的计算超参数

Table 1

| PINNs算法 | τP | τB | τD | lr | NN | NN |

|---|---|---|---|---|---|---|

| PINNs⁃S | 200 | 1 | 400 | 1e-3 | 100×4 | 60×4 |

| PINNs⁃H | 200 | 1 | 400 | 1e-3 | 100×4 | 60×4 |

图2

图2

一维稳态潜水流模型PINNs算法反演渗透系数的示意图

Fig.2

A schematic representation of PINNs algorithm for the inverse estimation of hydraulic conductivity in the one⁃dimensional steady⁃state groundwater flow model

采用式(

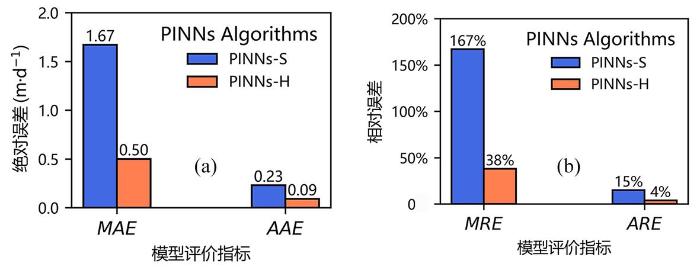

图3

图3

一维稳态潜水流模型中两种PINNs算法反演渗透系数的四种模型评价指标图

Fig.3

Four model evaluation indices for inversion of permeability coefficients by two PINNs algorithms in the one⁃dimensional steady⁃state unconfined flow model

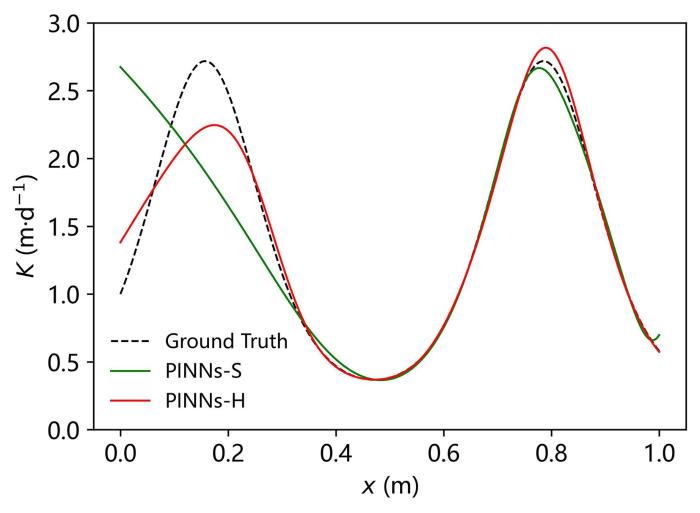

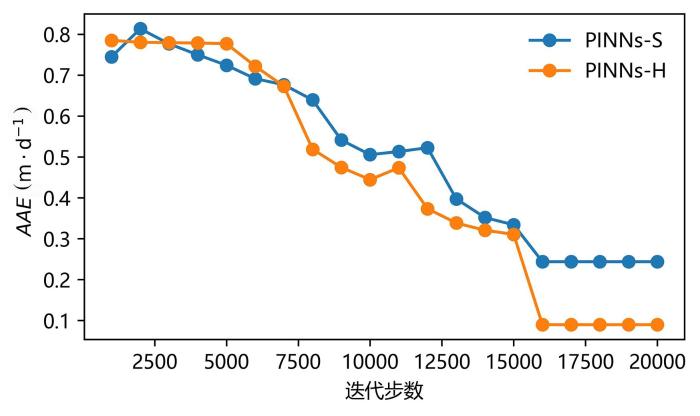

由图3可以看出,PINNs⁃H算法的表现要优于PINNs⁃S算法,PINNs⁃H算法的平均绝对误差为0.09,平均相对误差为4%,具有较高的反演精度.另外,从最大绝对误差(MAE)和最大相对误差(MRE)两项指标来看,PINNs⁃H算法的MAE比PINNs⁃S算法小1.17,而且前者的MRE比后者小129%,说明PINNs⁃H算法网络预测的稳定性比PINNs⁃S算法更好,这一点在图4中也得到了直观验证.从图4可以看到,在研究区域的后半段,两种PINNs算法的反演效果均较好,但在前半段,PINNs⁃S算法完全偏离了渗透系数的分布,PINNs⁃H算法较好地学习到了参数分布,效果明显优于前者.此外,图5对比了PINNs软约束和硬约束算法的收敛速度,PINNs⁃H算法的收敛速度整体上比PINNs⁃S算法快,最终平均绝对误差也小于后者.硬约束算法的收敛速度较快可能是因为硬约束为模型施加严格的边界条件,从而减小了神经网络需要搜寻的函数空间,使得PINNs能更快地找到优化方向,与此同时也保证了模型良好的学习能力.

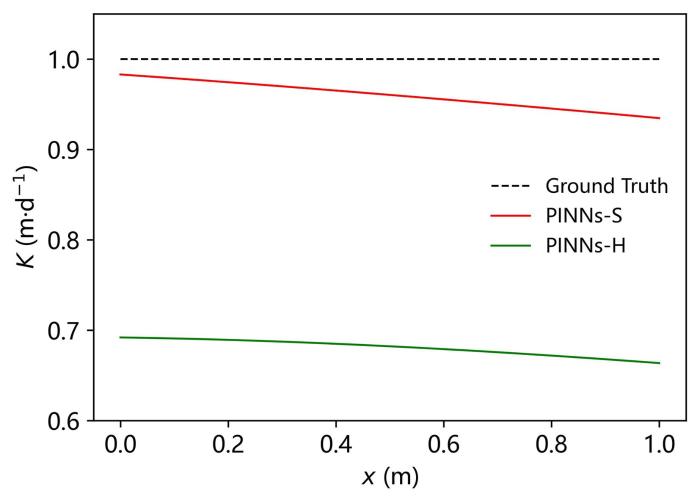

图4

图4

一维稳态潜水流模型中PINNs软约束和硬约束算法反演渗透系数结果图

Fig.4

Results of permeability coefficient inversion by PINNs soft and hard constraint algorithms in the one⁃dimensional steady⁃state unconfined flow model

图5

图5

一维稳态潜水流模型中两种PINNs算法反演渗透系数的AAE随迭代步数变化情况

Fig.5

Variation of AAE with iteration steps in inversion of permeability coefficients by two PINNs algorithms in the one⁃dimensional steady⁃state unconfined flow model

2.3 一维非稳态均质潜水流渗透系数的反演

地下水一维非稳态均质潜水流模型满足

表2 一维非稳态均质潜水流PINNs算例所采用的计算超参数

Table 2

| PINNs算法 | τP | τB | 𝜏τD | lr | NN | NN | NN |

|---|---|---|---|---|---|---|---|

| PINNs⁃S | 200 | 100 | 400 | 1e-3 | 100×6 | 60×6 | 100×6 |

| PINNs⁃H | 200 | 100 | 400 | 1e-3 | 100×6 | 60×6 | 100×6 |

图6

图6

一维非稳态潜水流模型PINNs算法反演渗透系数的示意图

Fig.6

A schematic representation of PINNs algorithm for the inverse estimation of hydraulic conductivity in the one⁃dimensional unsteady⁃state groundwater flow model

采用式(

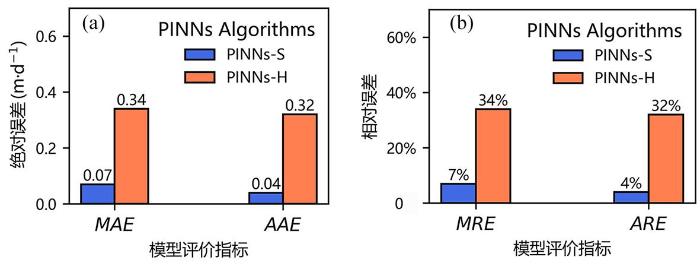

图7

图7

一维非稳态潜水流模型中两种PINNs算法反演渗透系数结果的四种模型评价指标图

Fig.7

Four model evaluation indices for results of permeability coefficient inversion by two PINNs algorithms in the one⁃dimensional unsteady⁃state unconfined flow model

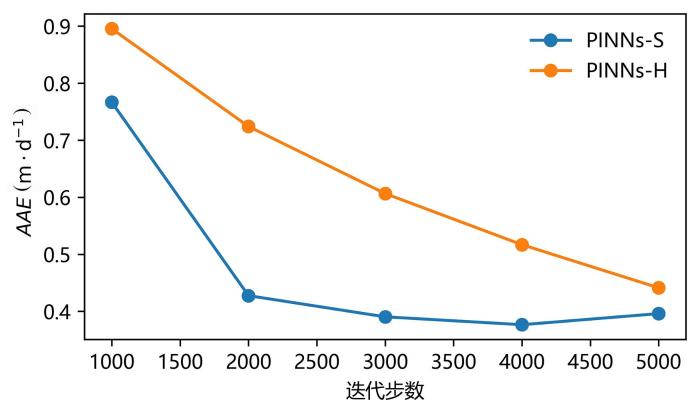

与我们的预期不同,由图7和图8可以看出,PINNs⁃S算法的表现优于PINNs⁃H,PINNs⁃S算法的最大绝对误差为0.07,平均绝对误差为0.04,具有较高的反演精度.从图9也可以直观地看到,PINNs⁃S算法的收敛速度明显比PINNs⁃H算法更快.这是一个有些反直觉的结果,硬约束边界条件的嵌入减小了需要搜索的函数空间,但是PINNs的精度和效率都在下降,推测其原因可能如下.PINNs的损失函数最小化可以看作是一个多目标优化问题.在PINNs的框架中,损失函数通常包含几个不同的组成部分,包括数据驱动的损失、物理驱动的损失、初始和边界条件的损失以及可能的其他正则化项,这些组成部分在优化时必须被同时考虑,因此PINNs的训练过程需要在各个目标之间找到平衡.在多目标优化中,这些不同的目标往往是相互冲突的,即提高一个目标的性能可能会损害另一个目标的性能.在本节问题中,硬约束虽然自动满足了边界条件,但同时也可能限制了网络寻找到最优的折中方案.而软约束有效地平衡了模型复杂性和训练数据的拟合,此外它还具有一定的灵活性,可以更好地适应新的数据,所以最后取得了更好的预测效果.因此,要根据具体问题和实验效果来恰当选取硬约束和软约束,并不是所有硬约束边界条件嵌入的神经网络都更优越.

图8

图8

一维非稳态潜水流模型中PINNs软约束和硬约束算法反演渗透系数结果图

Fig.8

Results of permeability coefficient inversion by PINNs soft and hard constraint algorithms in the one⁃dimensional unsteady⁃state unconfined flow model

图9

图9

一维非稳态潜水流模型中两种PINNs算法反演渗透系数的AAE随迭代步数变化情况

Fig.9

Variation of AAE with iteration steps in inversion of permeability coefficients by two PINNs algorithms in the one⁃dimensional unsteady⁃state unconfined flow model

3 结论

潜水流的数学模型是一种非线性偏微分方程,它的数值求解和方程参数反演都具有较大的挑战性.本文首次将结合物理规律和深度神经网络的PINNs方法应用到潜水含水层渗透系数反演问题.以一维稳态非均质潜水流以及非稳态均质潜水流(含溶质运移)的渗透系数反演为例,对比了不同问题中PINNs软约束方法(PINNs⁃S)和硬约束方法(PINNs⁃H)反演渗透系数的表现.计算结果表明,对于一维稳态非均质潜水流渗透系数的反演问题,PINNs⁃H无论是计算精度还是计算效率,都显著优于PINNs⁃S.这是因为PINNs⁃H将边界条件嵌入到水头函数的表达式中,其计算的水头值自动满足边界条件,训练神经网络时不需要计算边界点上的损失值,同时也减小了函数搜索空间.而将PINNs用到非稳定态潜水流模型时,结果显示PINNs⁃S的计算精度和收敛速度都优于PINNs⁃H.这说明对于复杂的非线性模型,软约束条件可能会更有效地平衡模型复杂性和训练数据的拟合,以避免过拟合的出现.因此,PINNs硬约束算法和软约束算法各有优劣,在实际应用中应根据具体问题和实验效果来合理选择.

此外,还有一些问题需要进一步研究,如PINNs软约束方法和硬约束方法具体在何种情况下或者何种问题设置中选用.为了处理工程实际问题,还需要将PINNs应用到更复杂的高维或非稳态非均质潜水含水层的渗流参数反演问题中.

参考文献

Trends prospects and challenges in quantifying flow and transport through fractured rocks

Approaches to highly parameterized inversion:A guide to using PEST for groundwater⁃model calibration

Three‐Dimensional permeability inversion using convolu⁃tional neural networks and positron emission tomography

Physics⁃informed deep learning for rock physical inversion and its uncertainty analysis

A transdisciplinary review of deep learning research and its relevance for water resources scientists

Physics⁃Informed Neural Networks:A deep learning framework for solving forward and inverse problems involving nonlinear partial differential equations

Bayesian deep convolutional Encoder–Decoder networks for surrogate modeling and uncertainty quantification

Prediction of porous media fluid flow using physics informed neural networks

GW⁃PINN:A deep learning algorithm for solving groundwater flow equations

Scientific machine learning through physics–informed neural networks:Where we are and what's next

基于物理信息的神经网络:最新进展与展望

,

Physics⁃Informed Neural Networks:Recent advances and prospects

Physics⁃Informed Neural Network (PINN) evolution and beyond:A systematic literature review and bibliometric analysis

基于PINNs算法的地下水渗流模型求解及参数反演

Simulation and parameter identifi⁃cation of groundwater flow model based on PINNs algorithms

Surrogate modeling for fluid flows based on physics⁃constrained deep learning without simulation data

Physics⁃informed neural networks with hard constraints for inverse design

,

Automatic differentiation in machine learning:A survey

On automatic differentiation

∥

An overview of gradient descent optimization algorithms

Adaptive subgradient methods for online learning and stochastic optimization

Construction and approximation for a class of feedforward neural networks with sigmoidal function

Dual rectified linear units (DReLUs):A replacement for tanh activation functions in Quasi⁃Recurrent neural networks

Rectifying the problem of vanishing gradient problem using relu activation function based on blstm neural network

Neural network integral representations with the ReLU activation function

Rectifier nonlinearities improve neural network acoustic models

∥

Swish:A self⁃gated activation function

Large⁃Scale machine learning with stochastic gradient descent

∥

DeepXDE:A deep learning library for solving differential equations

Systematic construction of neural forms for solving partial differential equations inside rectangular domains subject to initial boundary and interface conditions

Efficient uncertainty quantification for dynamic subsurface flow with surrogate by Theory⁃guided Neural Network